LATEST: Nvidia - Complete Analysis

Компания Nvidia выпустила Hotfix-драйвер версии 596.02. Он основан на драйвере GeForce Game Ready 595.97 WHQL, выпущенном днём ранее. Заплатка не относится к основной ветке драйвера Game Ready и является необязательной для установки.

Источник изображения: Nvidia

Согласно описанию Hotfix-драйвера версии 596.02, он исправляет лишь одну проблему — устраняет подтормаживания в ролевом экшене с элементами стратегии Arknights: Endfield.

Заплатки не являются полноценным WHQL-релизом драйвера, а фактически представляют собой бета-версии, которые следует устанавливать только тем, кто столкнулся с конкретными проблемами. Если описанная выше проблема не мешает (или пользователь с ней не столкнулся), то обновление можно смело пропустить и дождаться полноценной WHQL-версии программного обеспечения в рамках ветки Game Ready.

Скачать Hotfix-драйвер версии 596.02 можно с официального сайта Nvidia.

«Хейтерам это не остановить»: режиссёр Kingdom Come: Deliverance 2 встал на защиту DLSS 5

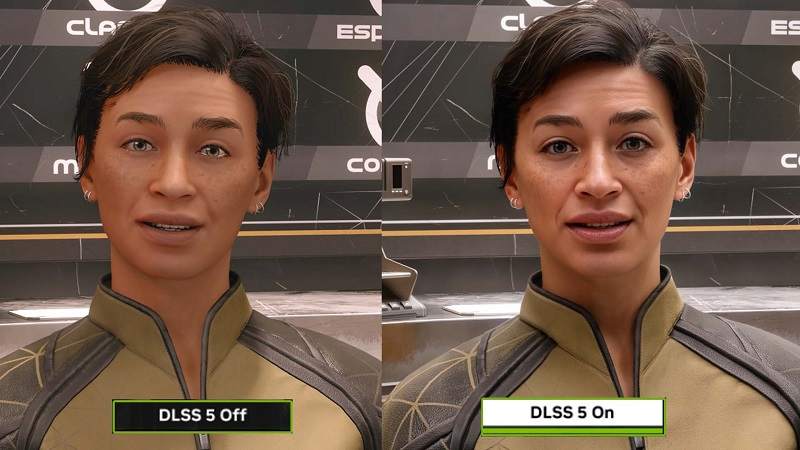

Режиссёр Kingdom Come: Deliverance и Kingdom Come: Deliverance 2 Даниэль Вавра (Daniel Vavra) прокомментировал перспективы интеллектуального масштабирования DLSS 5 от Nvidia на фоне массовой критики.

DLSS 5 использует модель нейронного рендеринга в реальном времени, которая насыщает кадры детализацией и фотореалистичным освещением. В глазах геймеров, однако, это преображение больше похоже на ИИ-фильтр.

Технология искажает визуальный стиль игр, заменяя его типовой «пластиковой» ИИ-картинкой. DLSS 5 жёстко раскритиковали не только простые пользователи, но и многие разработчики.

Одним из немногих сторонников DLSS 5 со стороны разработчиков игр оказался Вавра. По мнению режиссёра Kingdom Come: Deliverance 2, в будущем технология может стать «дешёвой» заменой ресурсоёмкой трассировке лучей.

«Это всего лишь немного зловещее начало. Хейтерам это не остановить, однозначно. Это нечто гораздо большее, нежели эффект мыльной оперы на каждом телевизоре при включении сглаживания движения», — уверен Вавра.

По мнению Вавры, в будущем разработчики смогут настроить DLSS 5 под конкретный визуальный стиль или лица определённых людей. Об этом ранее говорил и гендиректор Nvidia Дженсен Хуанг (Jensen Huang).

Релиз DLSS 5 ожидается осенью. Первыми играми с поддержкой технологии станут Resident Evil Requiem, Starfield, The Elder Scrolls IV: Oblivion Remastered, Assassin’s Creed Shadows, Hogwarts Legacy, Delta Force и Naraka: Bladepoint.

Новая статья: NVIDIA Groq 3: SRAM, дезагрегация, детерминизм

Данные берутся из публикации NVIDIA Groq 3: SRAM, дезагрегация, детерминизм

Nvidia выпустила драйвер GeForce с оптимизациями для свежих игр с DLSS, RT и Reflex

Nvidia выпустила свежий графический драйвер GeForce Game Ready 595.97 WHQL. В примечании к обновлению компания сообщает, что новое программное обеспечение оптимизирует работу с новейшими играми, поддерживающими DLSS, трассировку лучей, трассировку путей и Nvidia Reflex, а также обеспечивает наилучшее качество изображения в обширной библиотеке игр и приложений.

Новый драйвер исправляет проблемы с искажением текстур в игре Halo Infinite после установки предыдущих версий драйвера ветки R595. Также он исправляет проблемы со стабильностью в игре Hitman: World of Assassination при использовании технологии Nvidia Smooth Motion. Кроме того, он повышает общую стабильность в играх при использовании генератора кадров DLSS и функции Instant Replay.

Список известных проблем:

- в Enshrouded в некоторых местах отсутствует рельеф местности;

- в некоторых моментах при игре в Arknights: Endfield могут наблюдаться подтормаживания.

Скачать драйвер GeForce Game Ready 595.97 WHQL можно через приложение Nvidia App или с официального сайта Nvidia.

«Мне самому не нравится ИИ-мусор»: гендиректор Nvidia начал «с пониманием» относиться к критике DLSS 5

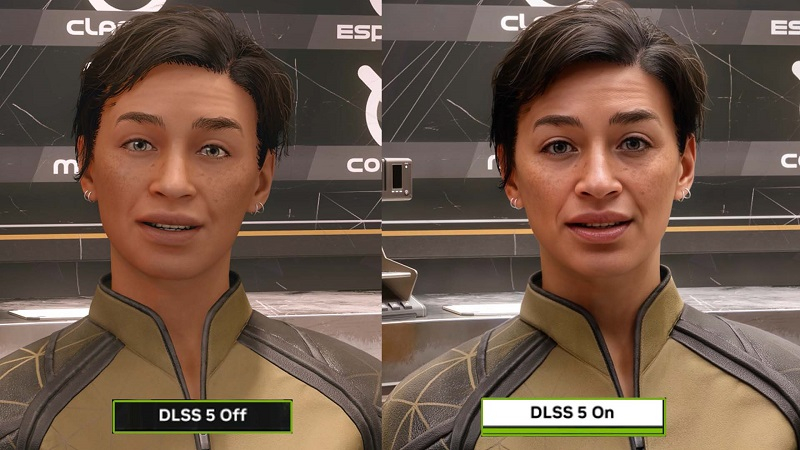

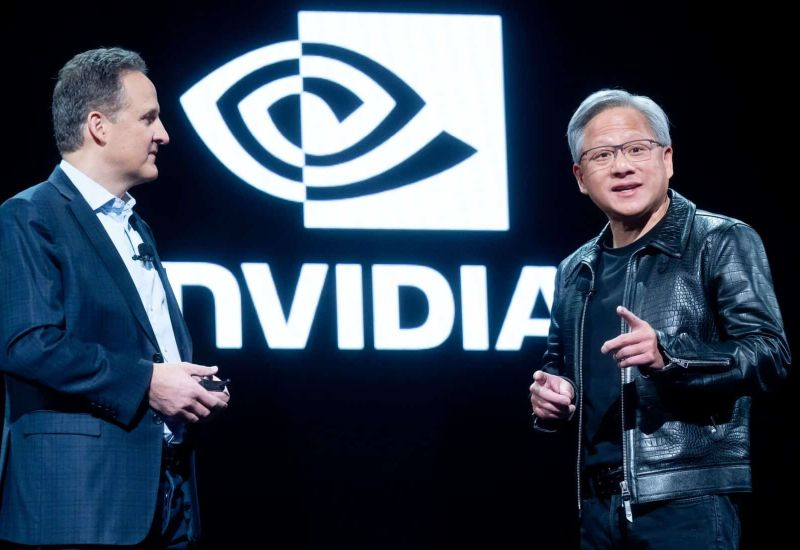

Гендиректор Nvidia Дженсен Хуанг (Jensen Huang) в интервью блогеру Лексу Фридману (Lex Fridman) вновь прокомментировал недовольство игроков масштабированием DLSS 5, и на этот раз руководитель звучал менее категорично.

Напомним, DLSS 5 использует модель нейронного рендеринга в реальном времени, которая насыщает кадры детализацией и фотореалистичным освещением. В глазах геймеров, однако, это преображение больше похоже на ИИ-фильтр.

Игроки массово раскритиковали DLSS 5 за то, как технология искажает визуальный стиль игр, заменяя его типовой «пластиковой» ИИ-картинкой. Вслед за анонсом Хуанг заявил, что геймеры «совершенно неправы».

В новом интервью Хуанг занял менее категоричную позицию. По словам руководителя Nvidia, он «с пониманием относится к тому, что думают люди» о DLSS 5, и сам не любит «ИИ-мусор».

«Думаю, их точка зрения имеет смысл, и я понимаю, почему они так думают. Мне самому не нравится ИИ-мусор. Сгенерированный ИИ контент, хоть и прекрасен, всё больше становится похож друг на друга», — подчеркнул Хуанг.

Руководитель также вновь опроверг идею, будто DLSS 5 меняет исходный кадр: «Художник задаёт геометрию, и мы остаёмся ей верны. <...> Она улучшает каждый кадр, но ничего не меняет».

На самом деле в качестве исходных данных DLSS 5 принимает лишь двухмерный отрисованный кадр и векторы движения, то есть вообще не берёт в расчёт созданную разработчиками трёхмерную геометрию. Релиз ожидается осенью.

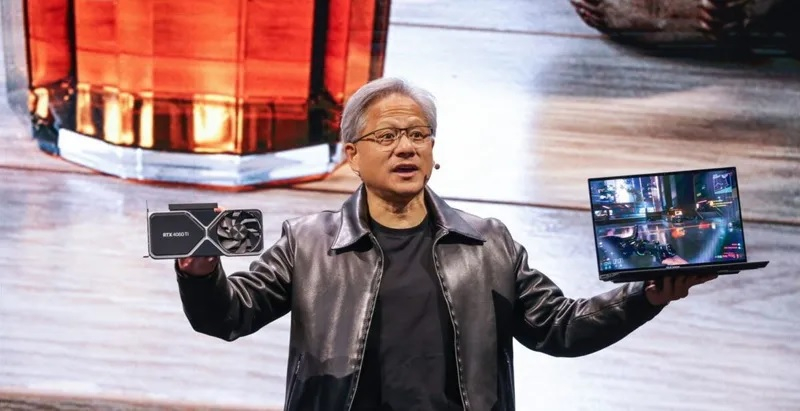

«Мы достигли AGI»: Хуанг заявил о создании сильного ИИ, но он ещё не способен создать Nvidia

На этой неделе вышел очередной подкаст Лекса Фридмана (Lex Fridman), в котором принял участие генеральный директор Nvidia Дженсен Хуанг (Jensen Huang). Во время беседы Хуанг сделал сенсационное заявление: «Я думаю, мы достигли AGI».

Источник изображения: Nvidia

Термином Artificial General Intelligence (AGI) принято называть «искусственный интеллект общего назначения» или «сильный ИИ», то есть систему, которая по возможностям сравнима с человеком или превосходит его. В последние месяцы технологические гиганты старались дистанцироваться от этого определения и пытались создать собственную терминологию, которая была бы менее разрекламированной, но более полезной и чёткой.

Ведущий подкаста определил AGI как ИИ-систему, способную «выполнять вашу работу», то есть создать, развить и управлять успешной технологической компанией стоимостью более $1 млрд. Затем он спросил Хуанга, когда AGI станет реальностью — через пять, десять или пятнадцать лет. Глава Nvidia на это ответил: «Я думаю, что это уже существует сейчас. Я думаю, мы достигли AGI».

Далее Хуанг упомянул OpenClaw — популярную платформу с открытым исходным кодом, которая позволяет создавать ИИ-агентов и пользуется большой популярностью. Он отметил, что люди используют индивидуальных ИИ-агентов для выполнения самых разных задач, и его «не удивит, если появится какое-то социальное явление или кто-то создаст цифрового инфлюенсера <…> либо какое-то социальное приложение, которое, скажем, будет “кормить” вашего маленького тамагочи или что-то в этом роде, и это неожиданно станет хитом».

Однако позднее Хуанг несколько смягчил свои предыдущие заявления. «Многие люди пользуются этим пару месяцев, а затем интерес сходит на нет. Вероятность того, что 100 000 таких агентов построят Nvidia, равна нулю», — добавил глава Nvidia.

Huawei представила ИИ-ускоритель Atlas 350, превосходящий Nvidia H20 по производительности

Huawei представила плату-ускоритель Atlas 350 для вывода в ИИ-системах и заявила, что новинка превосходит по вычислительной мощности Nvidia H20 для китайского рынка. Решение построено на чипе Ascend 950PR. Запуск состоялся на фоне расширения ИИ-предложений Huawei на базе собственных полупроводников. Компания наращивает это направление после прорывов в разработке чипов, включая линейку Ascend, без использования американских технологий.

Источник изображения: huawei.com

Руководитель направления Ascend Computing Чжан Дисюань (Zhang Dixuan) сообщил, что Atlas 350 развивает 1,56 Пфлопс в формате FP4 (формат вычислений с низкой точностью, ускоряющий передачу данных). Это в 2,8 раза выше показателя Nvidia H20, адаптированного для китайского рынка. Atlas 350 предназначена для вывода в поисковых рекомендациях, мультимодальной генерации и больших языковых ИИ-моделях. Плата-ускоритель представляет собой специализированный аппаратный модуль для установки в сервер.

В сентябре Huawei представила Ascend 950PR для задач предварительной обработки и рекомендаций в рамках трёхлетней дорожной карты развития Ascend. Предварительная обработка — базовый этап вывода ИИ-модели, на котором система обрабатывает все входные токены.

Huawei также ускоряет развитие вычислительного оборудования на фоне быстрого роста агентного ИИ, который резко увеличил спрос на вычислительные мощности и данные для систем, способных планировать и выполнять действия. В 2026 году Huawei намерена масштабно обновить линейку систем хранения, включая полностью твердотельные системы OceanStor Dorado и Pacific 9926 для корпоративного сегмента. Компания также планирует выпустить FusionCube A1000 для быстрого развёртывания ИИ в малых и средних компаниях.

Президент продуктовой линейки систем хранения Huawei Юань Юань (Yuan Yuan) заявил: «Если первая половина ИИ-эпохи была сосредоточена на вычислительной мощности, то вторая будет определяться данными. В 2026 году Huawei продолжит модернизацию своих линеек систем хранения и будет тесно участвовать в ключевых национальных проектах по созданию инфраструктуры данных».

Alibaba похвалилась выпуском 500 000 ИИ-ускорителей и признала, что они медленнее аналогов Nvidia

Руководство китайского технологического гиганта Alibaba подтвердило, что полупроводниковое подразделение компании произвело почти 500 000 чипов, в том числе для ускорителей искусственного интеллекта, но все они отстают от продукции Nvidia.

Источник изображения: alibabagroup.com

Входящий в Alibaba производитель полупроводников T-Head недавно провёл конференцию по итогам III квартала 2026 финансового года, в ходе которой его гендиректор Ёнмин Ву (Yongming Wu) сообщил, что компания выпустила почти 470 000 чипов, в том числе трёх моделей, разработанных специально для рабочих нагрузок искусственного интеллекта: XuanTie C908, TH1520 и Pingtouge Zhenwu 810E. Это значит, что Alibaba действительно наладила мощное производство полупроводников — для сравнения, за год выпущены 6 млн чипов Nvidia Blackwell.

Но одной только производственной мощностью всех задач решить не получится — китайские ИИ-ускорители от Alibaba T-Head уступают американской продукции, и в компании с этим не спорят. «Учитывая, что наши чипы всё ещё отстают от зарубежных аналогов по производительности в различных аспектах, мы стремимся углубить совместное проектирование с облачной инфраструктурой Alibaba и моделью Qwen для повышения эффективности. <..> Это одно из ключевых отличий и наш подход к проектированию чипов в T-Head, который выделяет нас среди прочих компаний — производителей чипов. Наша основная цель — создать систему ИИ с превосходным соотношением цены и качества», — отметил Ёнмин Ву.

Nvidia раскрыла, как DLSS 5 «додумывает» картинку — только 2D-кадр и векторы движения

Сотрудник Nvidia Джейкоб Фридман (Jacob Freeman) в недавнем интервью пояснил, по какому принципу работает технология масштабирования с использованием искусственного интеллекта DLSS 5. В качестве исходных данных система принимает двухмерный отрисованный кадр и векторы движения.

Источник изображения: nvidia.com

Таким образом, что Nvidia DLSS 5 вообще не берет в расчёт созданные разработчиками трёхмерную геометрию, глубину сцены или данные о материалах. Помимо 2D-изображения и секторов движения, лежащая в основе технологии масштабирования ИИ-модель понимает семантику сцены: идентифицирует волосы, ткань, кожу и условия освещения — и для анализа этих данных ей достаточно всего одного кадра. Она не считывает металличность, шероховатость, карты нормалей и другие основные свойства материалов, хотя по прежним описаниям Nvidia могло сложится впечатление, что DLSS 5 анализирует сцену более глубоко.

Это объясняет, почему некоторые примеры работы технологии выглядят непредсказуемо: одном из них у персонажа появились волосы там, где в оригинале их не было; в другом у него вообще изменились черты лица. Хотя Nvidia настаивает, что «базовая геометрия не изменилась», а на демонстрации использовалась «очень ранняя предварительная версия технологии».

Есть основания предположить, что у разработчиков довольно ограниченные средства управления DLSS 5. Они могут регулировать её интенсивность, цветокоррекцию, смешивание, контраст, насыщенность, гамму, а также применять маски для исключения указанных объектов из алгоритмов улучшения. Конкретных способов изменить коррекцию черт лица или исключить эффект макияжа разработчики тоже не могут — только уменьшить интенсивность эффекта, наложить маску или отключить алгоритм полностью. Лица же как таковые будут по-прежнему генерироваться ИИ.

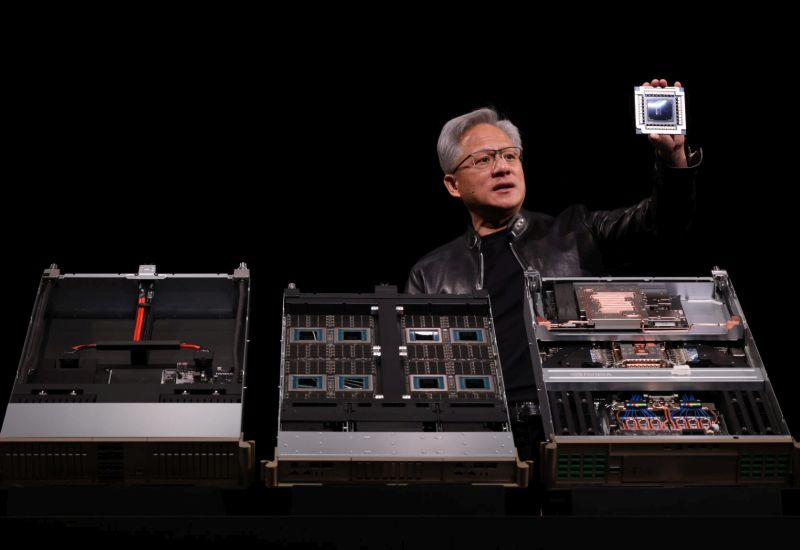

«Это не инопланетянин»: глава Nvidia призвал отрасль ИИ перестать пугать людей страшилками о технологии

Затянувшаяся история с конфликтом Anthropic и Пентагона по поводу безопасного и этичного использования ИИ в военной сфере не оставила шансов основателю Nvidia Дженсену Хуангу (Jensen Huang) отмолчаться на эту тему. Он призвал руководителей компаний, создающих генеративный ИИ, не «пугать людей страшилками» по поводу последствий его использования.

Источник изображения: Nvidia

«Желание предупредить людей о возможностях технологии — это потрясающе. Предупреждать — хорошо, пугать уже хуже, потому что эта технология очень важна для нас», — заявил глава Nvidia с трибуны конференции GTC 2026. По мнению Хуанга, для национальной безопасности США главным риском сейчас являются сами опасения по поводу того, что страна отстаёт от соперников в сфере освоения новых технологий.

Даже с учётом отстранения Anthropic от выполнения оборонных контрактов в США, по мнению Хуанга, дела у этой компании в финансовом плане пойдут нормально. Он считает, что к 2030 году выручка Anthropic перевалит за $1 трлн. По его мнению, глава стартапа Дарио Амодеи (Dario Amodei) в своих собственных прогнозах на этот счёт излишне консервативен. Как добавил Хуанг, представителям отрасли следует меньше стращать окружающих по поводу угроз, исходящих от ИИ. «Это не что-то биологическое. Это не инопланетянин. У него нет сознания. Это компьютерная программа. Говорить довольно экстремальные вещи, довольно катастрофичные, для которых нет никаких предпосылок к реализации, — само по себе может приносить больше ущерба, чем думают люди», — пояснил Дженсен Хуанг.

Он также призвал власти США не провоцировать Китай к захвату острова Тайвань, на котором сам родился и жил в детстве, пока родители не переехали в США, забрав с собой будущего основателя Nvidia. «Давайте демонстрировать сдержанность, никого ни к чему не подталкивать», — посоветовал глава Nvidia. При этом он призвал снизить концентрацию производства чипов на Тайване за счёт развития полупроводниковой промышленности не только в Южной Корее и Японии, но и в США. В последнем случае нужно действовать максимально быстро, как убеждён основатель Nvidia. Опыт Тайваня в сфере производства передовых чипов, по его словам, «заслуживает нашей дружбы и поддержки».

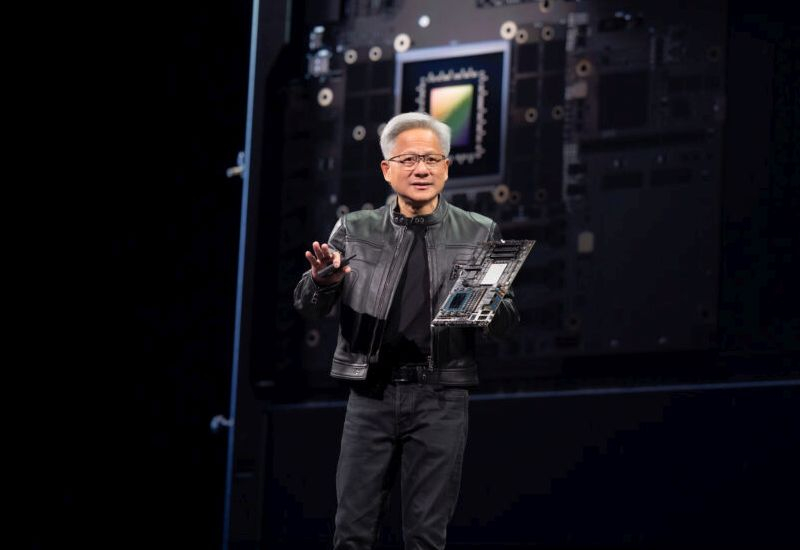

До конца следующего года Amazon купит у Nvidia миллион чипов для ИИ

Опасения некоторых инвесторов относительно назревания классического «пузыря» в сфере искусственного интеллекта то и дело разбиваются заявлениями о новых крупных сделках, демонстрирующих заинтересованность участников рынка в развитии профильной вычислительной инфраструктуры. Amazon до конца следующего года планирует закупить у Nvidia более 1 млн различных чипов для своей облачной инфраструктуры.

Источник изображения: Nvidia

Об этом сообщило агентство Reuters со ссылкой на официальное заявление обеих компаний. Финансовая сторона сделки не раскрывается, но Amazon достаточно охотно говорит о том, какие именно чипы Nvidia понадобятся облачному подразделению компании AWS. Помимо 1 млн графических процессоров для ускорения работы систем ИИ, американский облачный гигант закупит у Nvidia полный спектр сопутствующих решений, представленных на этой неделе. По крайней мере, сетевые коммутаторы Spectrum и новые чипы Groq (LPU) для работы с инференсом этому клиенту Nvidia тоже понадобятся в больших количествах. Поставки начнутся в этом году и продолжатся до конца следующего, как минимум.

Йен Бак (Ian Buck), вице-президент Nvidia по продуктам для гиперскейлеров и высокопроизводительным вычислениям, заявил следующее: «Инференс — это сложно, невероятно сложно. Чтобы быть лучшим в инференсе, требуется не один чип. Мы в действительности используем все семь чипов». В рамках указанной сделки Nvidia также поставит сетевое оборудование серий Connect X и Spectrum X в центры обработки данных AWS. Это особенно важно, поскольку исторически AWS использовала разработанные на заказ сетевые решения, а потому интеграция компонентов Nvidia потребует аналогичного индивидуального подхода.

Как фен помог обойти санкции: топ-менеджеров Supermicro обвинили в контрабанде ИИ-чипов в Китай

До сих пор все инциденты с подозрением американских регуляторов по поводу участия американских граждан в контрабандной поставке ИИ-ускорителей в Китай имели отношение к небольшим компаниям, но на днях обвинение было выдвинуто в адрес лиц, имеющих непосредственное отношение к руководству компании Supermicro.

Источник изображения: Super Micro Computer

Как подчёркивает CNBC, обвинительное определение Офиса федерального прокурора США по Южному округу Нью-Йорка содержит упоминания о частных лицах, связанных с неким американским производителем серверного оборудования, но из фамилий и имён обвиняемых становится понятно, что речь идёт именно о Super Micro Computer. Упоминаемый в документе И Шянь Лио (Yih-Shyan Liaw) является сооснователем компании и действующим членом совета директоров. Руэй Цань Чан (Ruei-Tsan Chang) руководит продажами оборудования этой марки на Тайване, а Тин Вэй Сунь (Ting-Wei Sun) является представителем подрядчика Supermicro.

По версии американских органов правопорядка, трое обвиняемых организовали нелегальный экспорт серверного оборудования с ускорителями Nvidia в Китай с использованием подставной компании в Юго-Восточной Азии, которая в документах значилась конечным получателем продукции. Ещё одна компания была задействована для переупаковки поставляемых грузов, чтобы скрыть факт их поставки в Китай.

Сообщается, что обвиняемые подготовили тысячи неработающих поддельных серверов для проверок, а затем снова использовали эти же «пустышки» во время проверки Министерства торговли США. По словам прокуроров, перед этой проверкой участники схемы с помощью обычного строительного фена сняли и заново наклеили этикетки и наклейки с серийными номерами, после чего переупаковали поддельные серверы в коробки производителя.

Обвиняемые, по версии следствия, оказывали давление на инспектирующие органы, а также пытались ввести в заблуждение представителя Министерства торговли США, которому была поручена дополнительная проверка поставок. Торговый представитель Supermicro на Тайване якобы участвовал в манипуляциях документами и пытался привлечь «нужного» аудитора к проверке.

Следствие считает, что И Шянь Лио в конце 2024 года пытался организовать поставки ускорителей Nvidia B200 в Китай через подставную компанию. Следователи располагают фрагментами переписки представителя Supermicro с предполагаемыми соучастниками. В 2025 году он торопил поставщиков, стремясь отправить в Китай больше оборудования до вступления в силу новых официальных запретов. Из троих фигурантов дела двое уже арестованы, тайваньский представитель Sipermicro находится в розыске. Акции компании на фоне таких новостей упали в цене на 12 %.

Kioxia представила серверный SSD Super High IOPS — он ускорит работу ИИ на чипах Nvidia

Nvidia и Kioxia работают над новой конструкцией твердотельных накопителей, которые обеспечат бесперебойную работу графических процессоров Nvidia для ИИ во время интенсивных задач обработки данных. Kioxia анонсировала накопитель E3.S CM9, позиционирующийся производителем как SSD со «сверхвысокой производительностью операций ввода-вывода в секунду» (Super High IOPS). Устройство предлагает ёмкость 25,6 Тбайт и способно перезаписывать данные три раза в день в течение всего гарантийного срока. Поставки образцов нового накопителя для оценки клиентами запланированы на конец 2026 года.

Источник изображения: Kioxia

Новый формат SSD является частью стратегии Kioxia и Nvidia по внедрению чрезвычайно быстрых накопителей для графических процессоров ИИ. Серия CM9 использует технологию Kioxia XL-Flash, которая рассчитана на достижение более 10 млн операций ввода-вывода в секунду, что примерно в три–четыре раза превышает показатели традиционных SSD для центров обработки данных. Технология XL-Flash изготовлена с использованием флеш-памяти SLC NAND (самого быстрого доступного типа флеш-памяти), которая обеспечивает задержку чтения всего от 3 до 5 микросекунд. Для сравнения, традиционные SSD обычно имеют пиковую производительность от 3 до 4 млн операций ввода-вывода в секунду и задержки чтения в диапазоне от 40 до 100 микросекунд.

Новые накопители Kioxia станут частью архитектуры Nvidia Storage-Next, в рамках которой серверы будут использовать эти накопители в сочетании с графическим процессором напрямую, обходя дополнительные задержки, возникающие при передаче данных через центральный процессор. Эта технология призвана компенсировать ограничения существующей памяти HBM, предоставляя графическим процессорам Nvidia для ИИ дополнительный слой кеш-памяти для хранения данных и поддержания работы ядер графического процессора на 100 % без простоев. Подход призван решить проблему масштабируемых моделей ИИ, размеры которых достигают триллионов параметров, а также контекстных окон, поддерживающих ввод миллионов токенов.

Как отмечает портал Tom’s Hardware, впервые реализация этой технологии была продемонстрирована на конференции GTC 2026 на примере архитектуры хранения данных BlueField-4 STX. BlueField-4 использует оптимизированный для хранения данных DPU и сетевой адаптер ConnectX-9 SuperNIC, которые, по утверждению Nvidia, обеспечивают до пяти раз большую пропускную способность токена, в четыре раза более высокую энергоэффективность и вдвое большую скорость загрузки страниц по сравнению с традиционными архитектурами хранения данных на базе ЦП.

Илон Маск заверил, что SpaceX AI и Tesla продолжат закупать много чипов Nvidia

Активное обсуждение планов Tesla по выпуску своих ИИ-чипов на американских предприятиях Samsung Electronics, по всей видимости, вынудило генерального директора Илона Маска (Elon Musk) сделать важное замечание со страниц социальной сети X. По его словам, SpaceX AI и Tesla продолжат закупать чипы Nvidia в значительных количествах.

Источник изображения: SpaceX

Характерно, что новая укрупнённая после объединения SpaceX и xAI компания Илона Маска впервые публично упоминается им под именем «SpaceX AI». Непосредственно стартапу xAI с прошлого года уже принадлежит социальная сеть X, ранее носившая имя Twitter. По сути, SpaceX AI теперь представлена и в аэрокосмической сфере, и в сегменте социальных сетей, и на рынке систем искусственного интеллекта.

Илон Маск отдельно пояснил, что разрабатываемый компанией Tesla чип AI5 действительно может использоваться в центрах обработки данных для обучения больших языковых моделей, но первичным его предназначением станут периферийные ИИ-вычисления в составе человекоподобных роботов Optimus и беспилотных такси. В ближайшие несколько недель Маск намерен представить крупное обновление программного обеспечения FSD, отвечающего за автопилот в электромобилях Tesla.

Напомним, что в конце этой недели Маск пообещал поделиться подробными данными о судьбе проекта гигантской фабрики по производству ИИ-чипов для нужд Tesla и смежных компаний, принадлежащих ему в той или иной степени. Миллиардер не раз отмечал, что оценивает потребности этих компаний в чипах высокими до степени, не позволяющей рассчитывать на удовлетворение спроса имеющимися контрактными производителями компонентов.

Nvidia стала гигантом сетевого оборудования — за квартал она получает как Cisco за год

Ведущую роль Nvidia в качестве поставщика ускорителей для инфраструктуры ИИ сложно оспаривать, но эксперты обращают внимание, что её бизнес по созданию сетевых решений с 2020 года заметно вырос, предлагая практически полный спектр компонентов и технологий, необходимых для построения центров обработки данных. Nvidia в денежном выражении даже затмила в этой сфере таких гигантов, как Cisco.

Источник изображения: Nvidia

Представители Zacks Investment пояснили TechCrunch, что Nvidia в сетевом сегменте сейчас за квартал получает столько же выручки, сколько Cisco аккумулирует за целый год. Например, в прошлом квартале выручка Nvidia на направлении сетевых решений достигла $11 млрд, она в годовом сравнении выросла на 267 %, а по итогам всего прошлого фискального года компания выручила в сетевом сегменте более $31 млрд.

Nvidia сейчас предлагает широкий спектр сетевых решений для создания инфраструктуры в центрах обработки данных. Интерфейс NVLink используется для скоростного обмена данными между компонентами вычислительных систем на базе компонентов Nvidia. Коммутаторы InfiniBand нужны для передачи информации внутри ЦОД, за Ethernet отвечают решения семейства Spectrum-X, а ещё Nvidia занимается кремниевой фотоникой с высокой степенью интеграции, которая позволяет наладить эффективную передачу данных по оптическим каналам связи.

По сути, именно сетевое направление сейчас является вторым в структуре бизнеса Nvidia по величине выручки после ускорителей ИИ, оно также в три раза обходит традиционное для компании игровое. В основу этого бизнеса легли разработки израильской Mellanox, которая была основана в 1999 году, а через одиннадцать лет была поглощена Nvidia за умеренные по нынешним меркам $7 млрд. Тогда подобная сделка заложила основы для эффективного масштабирования бизнеса Nvidia в сегменте ЦОД, поскольку без скоростных интерфейсов развивать подобную инфраструктуру невозможно. Сейчас Nvidia продаёт комплексное решение, сочетающее ускорители вычислений и сетевые компоненты, причём реализацией этого оборудования занимаются её партнёры. На минувшей GTC 2026 компания представила несколько новых сетевых решений, которые вошли в состав платформы Vera Rubin.